Jan 22, 2026

1. Brain–Computer Interfaces Enable Patients to Speak and Sing with Emotion in Real Time

Electrodes implanted in the motor cortex help record speech-related brain activity. Image source: Kateryna Kon

A study published in Nature on June 12, 2025, reported a major breakthrough in brain–computer interface (BCI) research. Scientists in the United States developed an AI-powered system capable of decoding neural signals associated with speech intent, allowing people with severe speech impairments to communicate expressively—and even sing—by translating thoughts directly into spoken language.

The research was led by a team at the University of California, Davis and involved a 45-year-old participant diagnosed with amyotrophic lateral sclerosis (ALS). Although the participant could still produce sounds and mouth movements, his speech had become slow and largely unintelligible.

Five years after symptom onset, researchers implanted 256 microelectrodes into the region of the brain responsible for motor control. Using deep learning algorithms, the system captured relevant neural signals every 10 milliseconds, enabling near real-time decoding of intended speech.

The study showed that the system could translate brain activity into spoken language almost instantaneously. When the participant asked questions, the system conveyed changes in intonation. He could emphasize selected words and even hum short sequences of notes at three different pitches.

Earlier BCI models typically required several seconds to generate speech or only produced output after the user attempted to mimic a full sentence. In contrast, the new system generated speech within 10 milliseconds after detecting speech-related neural activity, while also preserving natural vocal features such as tone, pitch, and stress. Researchers noted that the technology restores not only speech, but also emotional expression and personal identity.

2. First Integrated “Electronic–Photonic–Quantum” Chip System Developed

During testing, a packaged chip board was placed under a probe-station microscope. Image source: Boston University

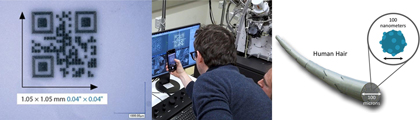

On July 17, Nature Electronics reported that a joint research team from Boston University, the University of California, Berkeley, and Northwestern University had developed the world’s first integrated “electronic–photonic–quantum” chip system. This marks the first time quantum light sources and stable electronic control circuits have been integrated onto a single chip using a standard 45-nanometer CMOS manufacturing process.

Just as conventional electronic chips rely on electrical currents and optical communication relies on lasers, future quantum photonic technologies require stable sources of “quantum light” to perform computation, communication, and sensing. To achieve this, the researchers built an array of so-called “quantum light factories” on a silicon chip. Each factory measures only about one square millimeter, yet can reliably generate pairs of correlated photons—an essential resource for quantum information applications.

A major challenge was maintaining quantum optical performance while adhering to the strict design constraints of commercial CMOS platforms. To overcome this, the team co-designed electronic and quantum photonic components as a unified system from the outset. The resulting chip includes built-in feedback mechanisms that compensate for temperature fluctuations and fabrication imperfections, paving the way for scalable quantum photonic systems.

3. Most Massive Black Hole Merger Ever Detected Challenges Formation Models

Illustration of the binary black hole merger GW231123. Image source: Caltech

An international collaboration using detectors such as LIGO in the United States detected the most massive black hole merger ever observed, providing new insights into how black holes grow.

The discovery, announced by the LIGO–Virgo–KAGRA Collaboration, originated from the detection of the gravitational-wave event GW231123 in November 2023. The two merging black holes had masses of approximately 100 and 140 times that of the Sun, forming a remnant black hole about 225 solar masses in size.

Both black holes were spinning at nearly 40 rotations per second, close to the theoretical stability limit. Their masses fall near or beyond the upper range of stellar-mass black holes, making them difficult to explain using conventional supernova formation models. Scientists suggest they may have formed through hierarchical mergers of smaller black holes, offering a new perspective on black hole evolution.

The findings were officially presented on July 14 at the 24th International Conference on General Relativity and Gravitation (GR24) in Glasgow.

4. Highest-Energy Neutrino Ever Detected—Twenty Times Previous Records

Engineers prepare to add a detector to the KM3NeT deep-sea network. Image source: Paschal Coyle, CNRS

On February 11, the KM3NeT Collaboration reported in Nature the detection of the highest-energy cosmic neutrino ever observed. Researchers believe the particle originated beyond the Milky Way, although its precise source remains unknown.

On February 13, 2023, the deep-sea detector ARCA recorded a high-energy muon signal. The muon’s energy was estimated at around 120 petaelectronvolts (PeV), while the parent neutrino was estimated to carry approximately 220 PeV—far exceeding previous observations.

The particle traversed the entire detector and triggered signals in more than one-third of its active sensors. Combined with its steep trajectory, the data strongly suggest that the muon originated from a cosmic neutrino interacting near the detector. The event was designated KM3-230213A.

Such ultra-high-energy neutrinos are thought to be produced by extreme cosmic phenomena, including supermassive black hole accretion, supernova explosions, and gamma-ray bursts. These findings offer valuable clues for understanding the most energetic processes in the universe.

5. First Time Crystal Visible to the Naked Eye Created

A time crystal observed under a microscope. Image source: Nature Materials

Time crystals are phases of matter that repeat periodically in time, much like conventional crystals repeat in space. Previously, time crystals had only been observed in complex quantum systems. In 2025, physicists reported the creation of a time crystal visible to the naked eye under specific conditions.

The findings, published on September 4 in Nature Materials, involved rod-shaped liquid crystal molecules that exhibit both liquid and solid properties. When illuminated with light, the surface of the liquid crystal formed rippling molecular patterns. Even when external conditions changed, these ripples continued to move for hours at varying rhythms.

The rhythms were not synchronized with any external driving force, satisfying the two defining criteria of time crystals. Researchers suggested that such thin layers of time crystals could be embedded in banknotes for anti-counterfeiting applications, producing dynamic two-dimensional optical patterns that are extremely difficult to replicate.

6. Genetically Modified Pig Organ Transplant Sets Survival Record

In July 2023, surgeons prepared to transplant a pig kidney into a brain-dead patient in New York. Image source: Shelby Lum

Scientists successfully prevented immune rejection of a genetically modified pig kidney, which survived for 61 days in a 57-year-old brain-dead human recipient—setting a new survival record.

Two papers published in Nature on November 13 identified key mechanisms behind immune rejection and suggested strategies to improve transplant outcomes. Over the past three years, more than a dozen patients have received genetically modified pig organs, though most failed due to immune rejection.

In this case, surgeons also transplanted a pig thymus, which helps train the human immune system to recognize pig cells as “self.” According to Robert Montgomery of the NYU Langone Transplant Institute, the thymus likely played a critical role in extending organ survival.

7. Ground-Based Telescope Detects Signals from the Universe 13 Billion Years Ago

Scientists detected scattered light from the first stars using a telescope in Chile. Image source: Shutterstock

Researchers from Johns Hopkins University and the University of Chicago used a ground-based telescope in the Chilean Andes to detect polarized microwave signals from the early universe—marking the first time such signals have been observed from Earth.

Published on June 11 in The Astrophysical Journal, the study sheds light on the so-called “cosmic dawn,” a poorly understood period just a few hundred million years after the Big Bang.

The observations were made using the CLASS experiment, which employs a uniquely designed ground-based telescope capable of filtering out atmospheric and terrestrial interference. The results provide new constraints on cosmic reionization and improve our understanding of the universe’s earliest structures.

8. Largest-Ever Map of the Universe Released

A screenshot from the COSMOS-Web interactive catalog. Image source: COSMOS-Web

On June 6, an international research collaboration released COSMOS-Web, the largest and most comprehensive map of the universe ever created, based on data from the James Webb Space Telescope (JWST).

The map includes more than 780,000 galaxies and spans 13.5 billion years, covering approximately 98% of cosmic history. JWST revealed far more early galaxies than expected—up to ten times more than predicted by previous models—challenging current theories of galaxy formation.

9. Largest and Most Detailed Brain Connectivity Map Completed

Rendering of more than 1,000 reconstructed brain cells from mouse tissue.Image source: Allen Institute for Brain Science

A series of papers published in Nature and Nature Methods on April 9 described the most detailed mammalian brain connectome ever created.

The achievement came from the MICrONS Project, involving more than 150 neuroscientists. The three-dimensional brain map contains over 200,000 cells, including approximately 82,000 neurons, more than 500 million synapses, and over 4 kilometers of neural wiring.

Using AI and machine learning, researchers linked structural connections with recorded neural activity, marking the first time large-scale neuronal activity has been mapped at single-neuron resolution.

10. AI Achieves Gold-Medal-Level Performance in the International Math Olympiad

The Gemini model generates rigorous mathematical proofs directly from problem descriptions. Image source: DeepMind

On July 21, Google DeepMind announced that its advanced Gemini AI model, equipped with a “deep reasoning” mode, achieved performance equivalent to a gold medal at the International Mathematical Olympiad (IMO).

The model successfully solved five out of six problems from the 2025 IMO, earning 35 points, a result officially verified by competition standards. The IMO, held annually since 1959, is widely regarded as one of the most demanding tests of mathematical reasoning.

The achievement highlights rapid progress in AI’s ability to perform advanced reasoning across algebra, geometry, combinatorics, and number theory.

MEHR LESEN